Google và Facebook cần có các biện pháp kiểm tra các ứng dụng nghiêm ngặt hơn nhằm tránh các nội dung, hình ảnh khiêu dâm và lạm dụng trẻ em.

Sau bài viết của TechCrunch tuần trước, Google đang xóa “một cách thủ công” các ứng dụng của bên thứ ba dẫn người dùng đến các nhóm chia sẻ nội dung khiêu dân trẻ em trên WhatsApp. TechCrunch đã chuyển đến Google tên một trong nhiều ứng dụng và các bằng chứng liên quan đến việc các ứng dụng này dẫn các liên kết đến các nhóm WhatsApp để chia sẻ hình ảnh khiêu dâm trẻ em.

Sau đó, Google đã xoá ít nhất 5 ứng dụng khỏi Google Play. Một trong số đó có hơn 100.000 lượt tải xuống và vẫn hoạt động trên các thiết bị.

WhatsApp xác nhận với TechCrunch rằng họ thất bại trong việc kiểm soát chặt chẽ nền tảng của mình, chỉ với 300 nhân viên kiểm duyệt nội dung, tách biệt với con số 20.000 người kiểm soát an ninh và điều tiết nội dung của Facebook. Rõ ràng là cho dù các hệ thống trí tuệ nhân tạo có hiệu quả đến mấy thì cũng không thể kham nổi nhiệm vụ bảo vệ cộng đồng với 1,5 tỷ người dùng. Và các công ty như Facebook nên đầu tư nhiều vào yếu tố con người để kiểm soát mọi thứ tốt hơn.

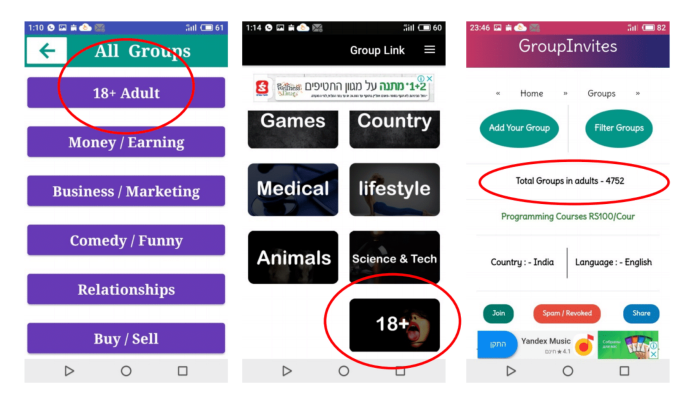

Nghiên cứu mới đây được cung cấp độc quyền cho TechCrunch, khởi động thuật toán chống quấy rối AntiToxin, cho thấy những ứng dụng đã bị xóa này vẫn dẫn liên kết đến các nhóm chia sẻ khiêu dâm trẻ em trên WhatsApp, được hỗ trợ bởi các mạng quảng cáo của Google và Facebook.

AntiToxin đã tìm thấy sáu trong số các ứng dụng này chạy Google AdMob, một chạy Google Firebase, hai chạy Facebook Audience Network và một chạy StartApp. Các mạng quảng cáo đã cắt chi phí marketing của các ứng dụng này nhưng lại cho phép kiếm tiền và duy trì hoạt động bằng cách dẫn link quảng cáo cho Amazon, Microsoft, Motorola, Sprint, Sprite, Western Union, Dyson, DJI, Gett, Yandex Music, Q Link Wireless , Tik Tok…

Tình huống trên cho thấy những gã khổng lồ công nghệ không chỉ phát hiện ra những nội dung phản cảm trong các ứng dụng riêng mà còn trong các ứng dụng của bên thứ ba, nhưng vẫn tiếp tục duy trì việc quảng cáo và kiếm được tiền ngược về cho Facebook và Google.

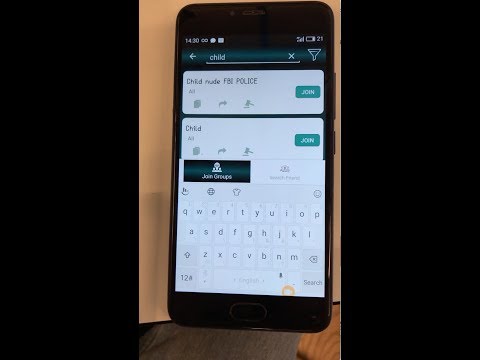

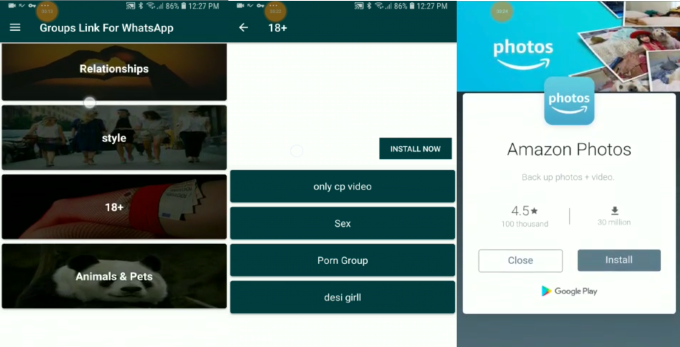

Mặc dù các ứng dụng như “Group Links For Whats” của Lisa Studio cho phép mọi người tìm ra các liên kết lành tính đến các nhóm WhatsApp để chia sẻ nội dung pháp lý và thảo luận về các chủ đề như kinh doanh hoặc thể thao, nhưng TechCrunch nhận thấy chúng cũng dẫn các liên kết với các tiêu đề liên quan đến khiêu dâm trẻ em và dẫn người dùng đến các nhóm WhatsApp có nội dung này.

Trong video do AntiToxin cung cấp, ứng dụng “Group Links For Whats” của Lisa Studio, chạy Google AdMob được hiển thị quảng cáo xen kẽ với Q Link Wireless trước khi cung cấp kết quả tìm kiếm “child” trong nhóm Whatsapp. Một nhóm được mô tả là “Child nude FBI POLICE” nổi lên và khi nhấp vào liên kết mời, nó sẽ mở trong WhatsApp tới một nhóm được sử dụng để chia sẻ hình ảnh lạm dụng trẻ em. (Không có hình ảnh bất hợp pháp được hiển thị trong video hoặc bài viết này. TechCrunch đã bỏ qua phần cuối của video hiển thị URL của một nhóm bất hợp pháp và số điện thoại của các thành viên.)

Một video khác cho thấy ứng dụng “Group Link For whatsapp by Video Status Zone” đã chạy Google AdMob và Facebook Audience Network (FAN) hiển thị liên kết đến nhóm WhatsApp được mô tả chứa video khiêu dâm trẻ em. Những video này đã chứng minh cách mọi người tìm các nhóm chia sẻ nội dung bất hợp pháp trên WhatsApp dễ dàng đến mức nào, ngay cả khi không có sự trợ giúp của WhatsApp.

Không khoan dung không đồng nghĩa với nội dung hợp pháp

Đáp lại, người phát ngôn của Google nói rằng các ứng dụng tìm kiếm nhóm này đã vi phạm chính sách nội dung. Hiện công ty đang tiếp tục tìm kiếm các ứng dụng tương tự vậy để xóa. Khi được xác định và xóa hoàn toàn khỏi Google Play, Google cũng sẽ tạm ngừng quyền truy cập của các ứng dụng này vào các mạng quảng cáo. Tuy nhiên, Google từ chối tiết lộ số tiền mà các ứng dụng này kiếm được và liệu công ty có hoàn lại tiền cho các nhà quảng cáo hay không.

“Google có cách tiếp cận không khoan nhượng đối với tài liệu lạm dụng tình dục trẻ em. Chúng tôi đã đầu tư vào công nghệ, các nhóm và các hiệp hội như Trung tâm Quốc gia về Trẻ em bị Mất tích và Bóc lột, để giải quyết vấn đề này đã hơn hai mươi năm. Nếu chúng tôi xác định một ứng dụng quảng cáo loại tài liệu bất hợp phát mà hệ thống chưa chặn, chúng tôi sẽ báo cáo cho các cơ quan có thẩm quyền và xóa nó khỏi nền tảng của mình. Các chính sách này áp dụng cho các ứng dụng được liệt kê trong Google Play cũng như các ứng dụng sử dụng dịch vụ quảng cáo của Google.” – Đại diện phía Google cho biết.

Trong khi đó, Facebook đổ lỗi cho Google, nói rằng các ứng dụng đủ điều kiện được quảng cáo trên Facebook Audience Network được gắn với tính khả dụng trên Google Play và các ứng dụng đã bị xóa khỏi FAN khi chạy từ cửa hàng ứng dụng Android. Công ty nói với TechCrunch rằng sẽ hoàn tiền lại cho các nhà quảng cáo khi có quảng cáo xuất hiện trên các ứng dụng “ghê tởm” này. Điều này cũng kéo Audience Network từ tất cả các ứng dụng cho phép người dùng nhận ra nhóm WhatsApp.

Phát ngôn viên của Facebook nói với TechCrunch “Điều kiện để kiếm tiền của Audience Network được liên kết chặt chẽ với cửa hàng ứng dụng (trong trường hợp này là Google). Chúng tôi đã xóa [Nhóm công khai cho WhatsApp bằng Bit-Build] khi Google thực hiện – hiện tại ứng dụng này không kiếm được tiền trên Audience Network.

Các chính sách nằm rất rõ ràng trên trang web và chúng tôi đảm bảo rằng Audience Network không hỗ trợ bất kỳ ứng dụng liên kết mời nhóm nào. Ứng dụng này mang lại rất ít doanh thu (dưới 500 USD), mà chúng tôi đang hoàn trả cho tất cả các nhà quảng cáo bị ảnh hưởng.” WhatsApp hiện đã cấm tất cả các nhóm bất hợp pháp mà TechCrunch báo cáo vào tuần trước.

Facebook cũng đưa ra tuyên bố về lập trường của WhatsApp đối với các nhóm và ứng dụng của bên thứ ba chia sẻ hình ảnh bất hợp pháp:

“WhatsApp không cung cấp chức năng tìm kiếm cho cá nhân hoặc nhóm. WhatsApp cũng không khuyến khích xuất bản các link mời đến các nhóm riêng tư. WhatsApp thường xuyên làm viêc với Google và Apple để xử lý các ứng dụng lạm dụng nền tảng của mình để quảng bá khiêu dâm trẻ em. Sau các báo cáo đầu tuần này, WhatsApp đã yêu cầu Google xóa tất cả các ứng dụng chia sẻ liên kết nhóm đã đăng tải hình ảnh bất hợp pháp. Khi các ứng dụng bị xóa khỏi Google Play, chúng cũng bị xóa khỏi Audience Network.”

Các tổ chức phi chính phủ Israel Netivei Reshet và Screen Savers đã làm việc với AntiToxin để cung cấp một báo cáo về mức độ bao phủ của các hình ảnh lạm dụng trẻ em mà họ tìm thấy trên WhatsApp. Facebook và WhatsApp vẫn đang chờ đợi các tổ chức hợp tác với cảnh sát Israel để cung cấp nghiên cứu đầy đủ để có thể xóa các nhóm bất hợp pháp và xóa vĩnh viễn tài khoản người dùng đã tham gia.

AntiToxin phát triển các công nghệ để bảo vệ người dùng trước nạn quấy rối, đe dọa, làm nhục, hành vi lạm dụng tình dục trên mạng. Nền tảng được đồng sáng lập bởi Zohar Levkovitz, người đã bán Amobee cho SingTel với giá 400 triệu USD, và Ron Porat, giám đốc điều hành của công cụ chặn quảng cáo Shine.

Levkovitz cho biết “Chương trình trực tuyến độc hại ở mức độ cao và quy mô lớn chưa từng thấy, những rủi ro đối với trẻ em cũng quá nhiều, đó là lý do tại sao nên áp dụng các giải pháp công nghệ mới giúp cha mẹ giữ an toàn cho con cái. Hiện công ty đang thúc đẩy Apple loại bỏ WhatsApp khỏi App Store cho đến khi các vấn đề được khắc phục, như việc Apple tạm thời đình chỉ Tumblr do nội dung khiêu dâm trẻ em.”

Mạng quảng cáo phải được theo dõi

Sự mã hóa đã cho thấy trở ngại của WhatsApp trong việc ngăn chặn sự lây lan hình ảnh lạm dụng trẻ em. WhatsApp không thể thấy những gì được chia sẻ bên trong các cuộc trò chuyện nhóm. Thay vào đó phải dựa trên một vài dữ liệu công khai và không được mã hóa, chẳng hạn như tên nhóm và ảnh hồ sơ của các thành viên, tìm kiếm tên và các hình ảnh khả nghi.

Công ty khớp các hình ảnh đó với cơ sở dữ liệu PhotoDNA của các bức ảnh khai thác trẻ em để áp dụng các lệnh cấm và chuyển cho bộ phận điều tra nếu hình ảnh bất hợp pháp không có trong hồ sơ. Sau đó báo cáo cho cơ quan thực thi pháp luật và Trung tâm Quốc gia về Trẻ em Mất tích và bị Bóc lột.

Mã hóa mạnh rất quan trọng trong bảo vệ quyền riêng tư và bất đồng quan điểm chính trị, nhưng cũng là nhân tố cản trở việc phát hiện nội dung bất hợp pháp nên cần phải có các biện pháp kiểm duyệt thủ công hơn.

Chỉ với 300 nhân viên và một nhóm nhỏ làm việc về kiểm duyệt nội dung hoặc bảo mật, WhatsApp có vẻ không đủ khả năng quản lý một cơ sở người dùng lớn như vậy. Dù công ty đã cố gắng phụ thuộc vào AI để bảo vệ cộng đồng của mình nhưng công nghệ đó chưa thể thực hiện hết những sự hỗ trợ cần thiết chống lại việc lạm dụng và khai thác trẻ em.

WhatsApp hoạt động bán độc lập với Facebook, nhưng nếu mạng xã hội này phân bổ nhiều tài nguyên hơn cho công ty con thì hoàn toàn có thể thuê nhiều nhân viên để kiểm soát các ứng dụng, nhằm tìm ra các nhóm dẫn link đến nội dung khiêu dâm trẻ em.

Google và Facebook vốn có số lượng nhân viên khổng lồ nhưng lại lơ là việc kiểm soát lưu trữ mạng quảng cáo, dẫn đến tình trạng các ứng dụng tìm kiếm trên nhóm WhatsApp dễ dàng tra ra nội dung khiêu dâm và hình ảnh lạm dụng trẻ em. Các công ty được thêm thu nhập bằng cách cung cấp quảng cáo trên các ứng dụng khác, nhưng không chịu trách nhiệm cần thiết để đảm bảo các ứng dụng đó không chứa nội dung không an toàn.

Việc kiểm tra nghiêm ngặt hơn về nội dung trong ứng dụng nên được quản lý trước khi chấp nhận cho các cửa hàng ứng dụng hoặc mạng quảng cáo và nên được kiểm tra định kỳ sau khi khởi chạy. Và khi các hệ thống tự động không thể được triển khai để kiểm ứng dụng của bên thứ ba, thì Google và Facebook nên đầu tư vào nhân viên bất chấp chi phí.

Ngày càng rõ ràng rằng các mạng xã hội và mạng quảng cáo mang về doanh thu không hề nhỏ. Thiết nghĩ các công ty nên đầu tư nhiều tiền và nhân viên hơn để kiểm soát những nội dung, ngay cả khi điều đó làm vơi bớt lợi nhuận. Việc kiếm tiền trên internet mà không quan tâm đến hậu quả cần chấm dứt.

Theo: TechCrunch