Công nghệ AI mới của Samsung có thể tạo ra một video giả mạo bạn chỉ từ việc trộm một tấm ảnh cá nhân trên Facebook. May mắn là kẻ xấu vẫn chưa có chúng.

Phần mềm để tạo các hình ảnh sâu (deepfakes) – video clip được tạo ra khiến nạn nhân trông như làm hoặc nói những điều mà thực tế họ chưa từng làm – thường yêu cầu các tập hợp dữ liệu lớn của hình ảnh để tạo ra sự giả mạo. Nhưng Samsung đã phát triển một hệ thống trí tuệ nhân tạo mới, có thể tạo ra video clip giả bằng cách chỉ đưa vào một dữ liệu rất ít, như chỉ cần một bức ảnh.

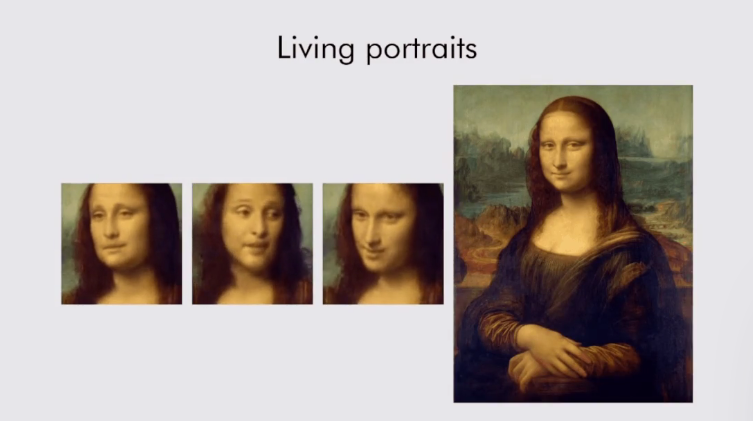

Công nghệ này tất nhiên có thể được sử dụng cho vui như mang một bức chân dung cổ điển vào cuộc sống. Mona Lisa, tác phẩm chân dung nổi tiếng thế giới chỉ tồn tại dưới dạng một hình ảnh tĩnh duy nhất với nụ cười mê hoặc, đã được thể hiện trong ba video khác nhau để thể hiện công nghệ mới. Theo đó, một phòng thí nghiệm trí tuệ nhân tạo của Samsung ở Nga đã phát triển công nghệ, được trình bày chi tiết trong một bài báo vào đầu tuần này.

Nhưng nhược điểm lớn của những loại kỹ thuật này và sự phát triển nhanh chóng của chúng cũng tạo ra rủi ro về thông tin sai lệch, giả mạo bầu cử và gian lận, theo Hany Farid, một nhà nghiên cứu của Dartmouth chuyên về pháp y truyền thông để tìm ra những lỗ hổng của deepfakes.

Farid nói “Theo xu hướng của năm vừa qua, kỹ thuật này và các vấn đề liên quan đòi hỏi dữ liệu ngày càng ít hơn và ngày càng tạo ra nhiều nội dung phức tạp và hấp dẫn hơn”, Mặc dù quy trình của Samsung có thể tạo ra những trục trặc hình ảnh, “những kết quả này là một bước trong quá trình phát triển các kỹ thuật dẫn đến việc tạo ra nội dung đa phương tiện mà cuối cùng sẽ không thể phân biệt được với thực tế.”

Giống như Photoshop cho video, phần mềm deepfake tạo ra các đoạn video giả mạo bằng cách sử dụng máy học để chế tạo con người biết nói, di chuyển. Mặc dù máy tính điều khiển video đã tồn tại trong nhiều thập kỷ, nhưng các hệ thống deepfake đã làm cho các clip được chỉnh sửa không chỉ dễ tạo hơn mà còn khó phát hiện hơn.

Rất nhiều tác phẩm giống như tác phẩm hoạt hình Mona Lisa là trò vui vô hại. Công nghệ này đã tạo ra toàn bộ thể loại meme, như việc khuôn mặt của Nicolas Cage được đưa vào phim và chương trình truyền hình mà anh ta không tham gia. Nhưng công nghệ deepfake cũng có thể xảo quyệt, chẳng hạn như khi nó được dùng để ghép khuôn mặt của một người không vào phim người lớn rõ ràng, một kỹ thuật đôi khi được sử dụng để trả thù.

Trong bài báo, phòng thí nghiệm AI của Samsung đã đặt tên cho sáng tạo của mình là “những cái đầu biết nói thần kinh thực tế”. Thuật ngữ “những cái đầu biết nói” chỉ thể loại video mà hệ thống có thể tạo ra; tương tự như những hộp video của các học giả bạn thấy trên tin tức trên TV. Từ “thần kinh” là một loại hình học máy bắt chước bộ não của con người.

Các nhà nghiên cứu đã thấy bước đột phá của họ được sử dụng trong một loạt các ứng dụng, bao gồm các trò chơi video, phim và TV. “Có thể có các ứng dụng thực tế cho khả năng ngoại cảm, bao gồm hội nghị truyền hình và trò chơi nhiều người chơi, cũng như ngành công nghiệp hiệu ứng đặc biệt”, họ viết.

Bài báo được kèm theo một video cho thấy sự sáng tạo của nhóm, điều này cũng tình cờ được ghi với một nhạc nền lạnh lẽo đến khó tin.

Thông thường, một cái đầu nói chuyện yêu cầu bạn huấn luyện một hệ thống trí tuệ nhân tạo trên một tập hợp dữ liệu lớn các hình ảnh của một người. Vì rất nhiều hình ảnh của một cá nhân là cần thiết, các mục tiêu deepfake thường là những nhân vật của công chúng, chẳng hạn như những người nổi tiếng và chính trị gia.

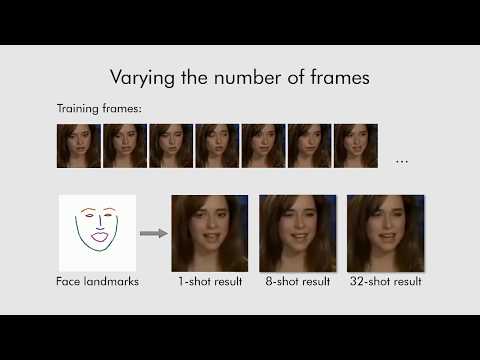

Hệ thống Samsung sử dụng một mánh khóe dường như lấy cảm hứng từ câu nói nổi tiếng của Alexander Graham Bell, “Trước bất cứ điều gì, sự chuẩn bị là chìa khóa để thành công.” Hệ thống bắt đầu với một “giai đoạn siêu học tập” dài, trong đó nó xem rất nhiều video để tìm hiểu cách khuôn mặt của con người di chuyển. Sau đó, chương trình áp dụng những gì nó học được cho một bức ảnh tĩnh hoặc một số ít ảnh để tạo ra một video clip thực tế hợp lý.

Không giống như một video deepfake thực sự, kết quả từ một số lượng nhỏ hình ảnh bị mờ khi tái tạo các chi tiết. Ví dụ, một video giả mạo của Marilyn Monroe trong video demo của phòng thí nghiệm Samsung đã bỏ lỡ nốt ruồi nổi tiếng của cô đào này, theo Siwei Lyu, giáo sư khoa học máy tính tại Đại học Albany ở New York, chuyên về pháp y truyền thông và học máy. Điều đó cũng có nghĩa là các video được tổng hợp có xu hướng giữ lại một số ngữ nghĩa của bất kỳ ai đóng vai trò của con rối kỹ thuật số. Đó là lý do tại sao mỗi khuôn mặt Mona Lisa chuyển động trông giống như một người hơi khác nhau.

Nói chung, một hệ thống deepfake nhằm mục đích loại bỏ những trục trặc hình ảnh. Điều đó đòi hỏi lượng dữ liệu đào tạo có ý nghĩa từ cả video đầu vào và mục tiêu.

Lyu nói, khía cạnh vài lần hoặc một lần của phương pháp này rất hữu ích, vì điều đó có nghĩa là một mạng lớn có thể được đào tạo trên một số lượng lớn video, đây là phần mất nhiều thời gian. Loại hệ thống này sau đó có thể nhanh chóng thích ứng với một mục tiêu mới chỉ sử dụng một vài hình ảnh mà không cần đào tạo lại. “Điều này giúp tiết kiệm thời gian và làm cho mô hình trở nên khái quát.”

Theo Cnet