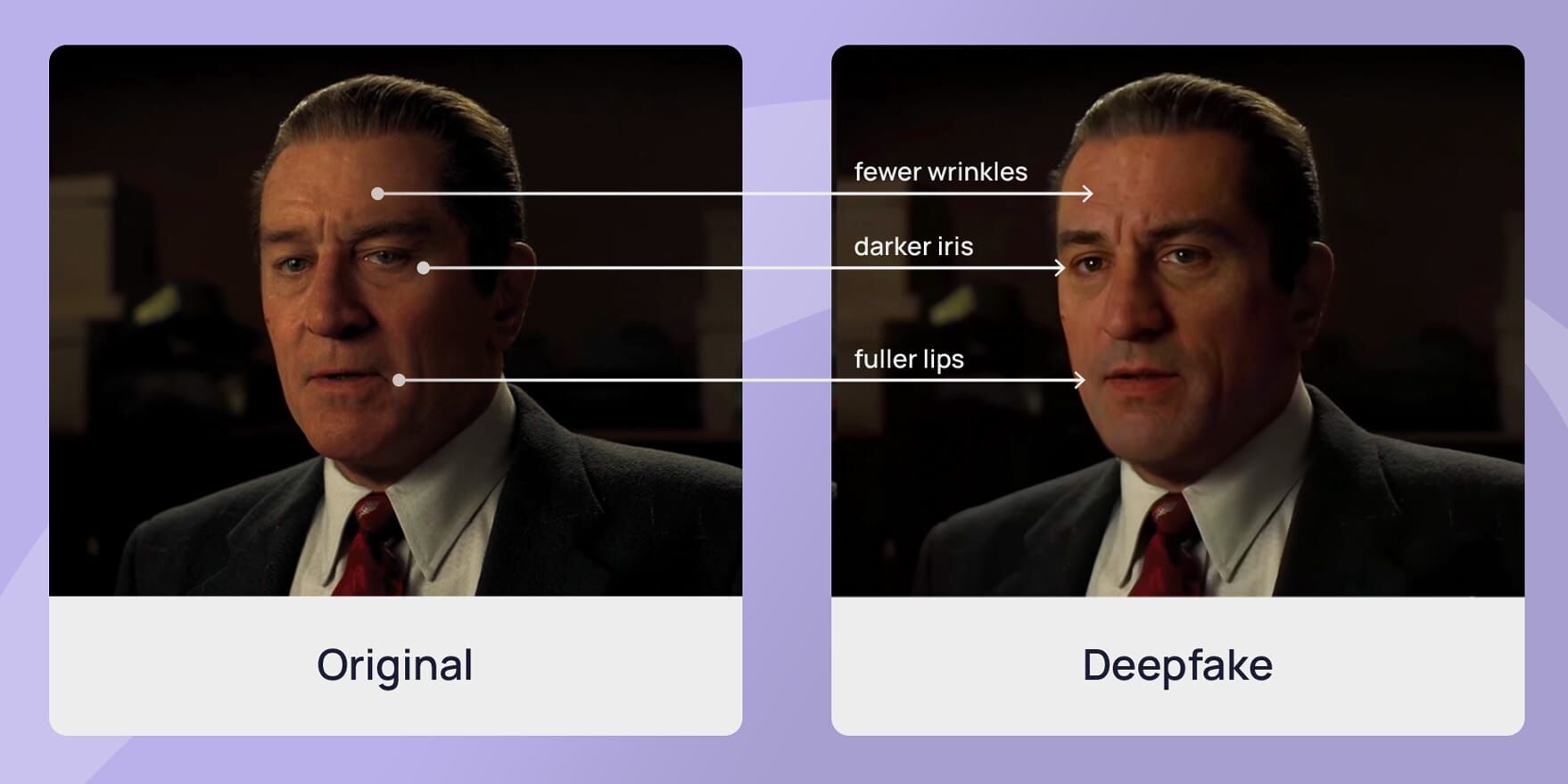

“deepfake” – là những nội dung do AI tạo ra, giống hệt với con người, địa điểm và sự kiện hiện có theo cách không chân thực

Ngay sau khi Ukraine bị tấn công vào năm 2022, các nhiếp ảnh gia trong nước đã bắt đầu ghi lại những hình ảnh các di tích văn hóa bị tàn phá để giúp bảo tồn di sản quốc gia và thu thập chứng cứ cho việc phục hồi. Tuy nhiên, sự lan truyền của những hình ảnh giả liên quan đến chiến tranh đã gây ra một vấn đề: Mọi người không thể chắc chắn bức ảnh nào là thật.

Để ứng phó với điều này, các nhiếp ảnh gia đã sử dụng một công cụ mới giúp chứng minh rằng những bức ảnh của họ không phải là ảnh giả hay còn gọi là “deepfake” – là những nội dung do AI tạo ra, giống hệt với con người, địa điểm và sự kiện hiện có theo cách không chân thực. Nguyên mẫu này đã dẫn đến sự ra đời của bộ công cụ đảm bảo tính chân thực của nội dung Content Integrity Suite của Microsoft, được thiết kế giúp tăng cường tính minh bạch cho các nội dung trực tuyến.

“Những hậu quả từ deepfake có thể cực kì nghiêm trọng. Đây là một dạng tấn công vào nhận thức, làm thay đổi cách bạn nhìn nhận thực tế và suy nghĩ về thế giới,” ông Andrew Jenks, Chủ tịch của Liên minh Xác minh và Chứng thực Nội dung (C2PA), một tổ chức do Microsoft đồng sáng lập nhằm phát triển một tiêu chuẩn kỹ thuật mở để chứng minh nguồn gốc và lịch sử của các nội dung số, bao gồm cả các sản phẩm do AI tạo ra.

Việc chỉnh sửa nội dung không phải là điều mới mẻ và đôi khi rõ ràng là trò đùa hoặc có mục đích châm biếm. Tuy nhiên, sự phát triển của AI tạo sinh đang tạo cơ hội cho những kẻ có động cơ xấu dễ dàng phát tán những thông tin sai lệch, dẫn đến những nguy cơ nghiêm trọng như gian lận, đánh cắp danh tính, can thiệp bầu cử và các thiệt hại khác.

Các thông tin về nguồn gốc thường biến mất khi nội dung được chia sẻ, khiến người dùng khó phân biệt đâu là thông tin đáng tin cậy. Việc xác định nguồn gốc và truy vết lịch sử của nội dung sẽ giúp mọi người hiểu rõ hơn và tránh bị lừa gạt, ông Andrew Jenks cho biết thêm.

Bộ công cụ đảm bảo tính chân thực của nội dung Content Integrity Suite của Microsoft gồm có một ứng dụng, hiện đang ở giai đoạn thử nghiệm riêng, cho phép các nhà sáng tạo và nhà xuất bản đưa thêm Thông tin Xác thực Nội dung (Content Credentials) vào những tác phẩm của họ, hoặc chèn siêu dữ liệu được xác thực với các thông tin như ai tạo ra nội dung, vào thời điểm nào và liệu có sử dụng AI hay không.

Là một phần của tiêu chuẩn kỹ thuật C2PA, Thông tin Xác thực Nội dung sẽ được mã hóa vào các bức ảnh, video và âm thanh, giúp dễ dàng phát hiện việc chỉnh sửa hoặc can thiệp sau này.

Vì siêu dữ liệu là vô hình, nên Microsoft cũng cung cấp công cụ kiểm tra tính toàn vẹn của nội dung và tiện ích mở rộng trên trình duyệt web, giúp người dùng quét thông tin xác thực và xem thông tin xuất xứ. Người dùng cũng có thể tìm biểu tượng Thông tin Xác thực Nội dung trên hình ảnh và video trên các nền tảng như LinkedIn.

Ông Jenks chia sẻ, “Cho dù AI có được sử dụng hay không thì Thông tin Xác thực Nội dung cũng mang lại một lớp minh bạch quan trọng, giúp mọi người đưa ra quyết định chính xác hơn về những nội dung mà họ tiếp nhận và chia sẻ trực tuyến. Khi việc xác định nguồn gốc và lịch sử của nội dung trở nên dễ dàng hơn, mọi người sẽ có xu hướng cảnh giác hơn với những tài liệu thiếu thông tin về nguồn gốc rõ ràng.”

Microsoft cũng đang áp dụng công cụ Thông tin Xác thực Nội dung trong các sản phẩm AI tạo hình ảnh của mình như Designer, Copilot, Paint và một số mô hình trong Azure OpenAI Service để công khai việc sử dụng AI, thông tin về thời điểm tạo hình ảnh và các chi tiết khác. Các biện pháp AI có trách nhiệm khác nhằm ngăn chặn việc lạm dụng deepfake gồm có việc làm mờ khuôn mặt trong các bức ảnh tải lên trên Copilot.

Microsoft đã thúc đẩy tính toàn vẹn của thông tin thông qua việc đồng sáng lập C2PA – tổ chức hiện có gần 200 thành viên – phát triển các công nghệ xác thực nguồn gốc cùng với các phóng viên và hỗ trợ các quy trình dân chủ. Chúng tôi biết rằng, không một công ty hay giải pháp riêng lẻ nào có thể giải quyết vấn đề này một cách toàn diện.

Vì vậy, Microsoft cũng đang kêu gọi ban hành các quy định pháp lý liên quan và nghiên cứu thêm các phương pháp xác thực tính minh bạch mới. Những nỗ lực này là sự kết hợp giữa chuyên môn về nghiên cứu, kỹ thuật, chính sách và tình báo an ninh, nhằm củng cố hệ thống thông tin trong bối cảnh phức tạp của các loại hình và nền tảng truyền thông khác nhau.

Cách nhận diện Deepfakes

- Nhận diện và hiểu rõ nguồn gốc: tìm thông tin về nguồn gốc, mô tả hoặc Thông tin Xác thực Nội dung. Tìm kiếm thông qua công cụ tìm kiếm hình ảnh. Đánh giá mức độ uy tín của nguồn thông tin. Nếu nguồn gốc không rõ ràng, hãy cẩn trọng trước khi sử dụng.

- Xem xét mục đích: Nội dung này được tạo ra với mục đích giải trí, cung cấp thông tin hay thuyết phục người xem? Phân tích mục đích có thể giúp bạn nhận biết liệu bạn có đang bị lừa dối hay thao túng hay không.

- Tìm kiếm các dấu hiệu bất thường: Các hình ảnh hoặc nội dung do AI tạo ra thường chứa lỗi chính tả, chi tiết mờ nhòe, không rõ nét, trang phục không khớp, ánh sáng không đồng nhất giữa các chi tiết, kết cấu bề mặt kỳ lạ hoặc thiếu tự nhiên.

- Kiểm tra kỹ năng nhận diện AI: Bạn có thể thử bài test Real or Not để rèn luyện khả năng phân biệt nội dung thật và nội dung do AI tạo ra.